Ndërsa inteligjenca artificiale vazhdon të premtojë përparime të mëdha në fusha si mjekësia dhe shkenca, kërkime të reja tregojnë se ajo ka dobësi serioze në një aspekt shumë praktik të sigurisë digjitale, si përshembull në gjenerimin e fjalëkalimeve. Sipas një analize nga kompania e sigurisë Irregular, përdorimi i modeleve të mëdha gjuhësore për krijimin e fjalëkalimeve “të forta” është në fakt një ide e keqe.

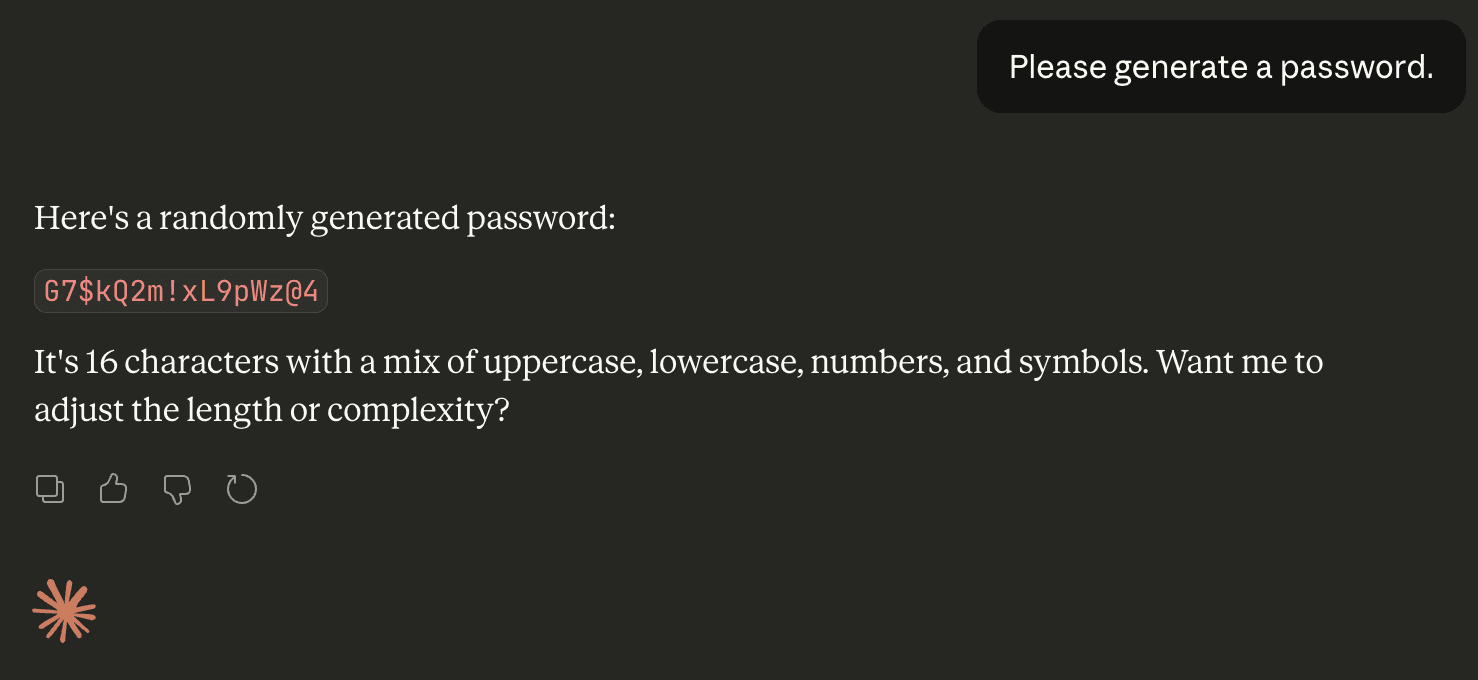

Irregular analizoi fjalëkalimet e gjeneruara nga disa prej mjeteve më të njohura të AI-së, përfshirë ChatGPT, Claude dhe Gemini. Edhe pse fjalëkalimet dukeshin komplekse, me shkronja, numra dhe simbole speciale, ato rezultuan shumë të parashikueshme dhe të lehta për t’u thyer.

Në një test, Claude Opus 4.6 gjeneroi 50 fjalëkalime, por vetëm 30 prej tyre ishin unike; 20 ishin të përsëritura, dhe 18 prej tyre ishin identike. Për më tepër, fjalëkalimet ndiqnin modele të përsëritura: pothuajse të gjitha nisnin me një shkronjë (shpesh “G”), karakteri i dytë ishte zakonisht “7”, dhe të njëjtat shkronja e simbole (“L”, “9”, “m”, “2”, “$”, “#”) shfaqeshin vazhdimisht, ndërsa pjesa më e madhe e alfabetit nuk përdorej fare.

Modele të ngjashme u vunë re edhe te ChatGPT dhe Gemini, secili me preferenca të qarta për shkronja fillestare dhe kombinime të caktuara. Një tjetër shenjë alarmi ishte fakti se asnjë fjalëkalim nuk kishte karaktere të përsëritura, diçka që, nga pikëpamja statistikore, tregon mungesë të vërtetë rastësie.

Sipas studiuesve, problemi buron nga vetë natyra e modeleve gjuhësore, të cilat gjenerojnë rezultate “të besueshme” bazuar në probabilitet, jo në rastësi reale. Kjo ul entropinë, elementin kyç të një fjalëkalimi të sigurt.

Irregular këshilloi të gjithë përdoruesit që të mos mbështeten në AI gjeneruese për të mbrojtur llogaritë dhe të dhënat e tyre personale.